Perceptron이란?

인공 신경망의 가장 간단한 형태를 의미한다.

딥러닝의 역사는 perceptron을 시작으로 발전해왔는데, GATE를 통해 조금 더 자세히 알아보자.

AND GATE는 x1, x2가 모두 1이면 1이고 나머지는 0으로 연산하는 GATE를 의미한다. Perceptron은 입력값을 받아들이고, 여기에 가중치를 곱한 후, 편향을 더하여 계산을 한다.

위의 그림에서 $$f(-0.8 + 0.5x_1 + 0.5x_2)$$ 에서 0.5가 각각의 가중치이며 -0.8이 편향이다.

Hard thresholding은 0보다 작으면 0, 1보다 크면 1 을 의미한다.이와 같은 방법으로 GATE에 대한 perceptron의 결과를 확인해보면,

다음과 같은 결과가 나온다. 선을 기준으로 0과 1을 구분할 수 있게 된다.

마찬가지로, 둘 다 0일 때만 0을 가지고 나머지는 1의 값을 가지는 OR GATE도 perceptron으로 계산을 한 결과를 살펴보면,

다음과 같은 결과를 확인할 수 있다.

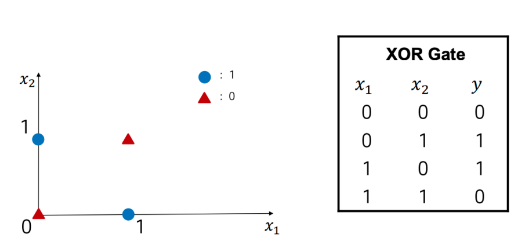

이처럼, 가중치와 편향을 조정하여 입력 데이터를 올바르게 분류할 수 있는 perceptron이 해결하지 못한 GATE가 바로 XOR GATE이다.

Figure 5에서 살펴볼 수 있듯이, 위의 GATE들과는 다르게 1개의 선만으로는 분류하는 것이 불가능하다. Linear한 경계선 하나만으로 값을 구분해낼 수 없다는 문제점을 해결하기 위해,

여러 개의 perceptron을 사용하게 되었고, 이를 MLP (Multi-Layer Perceptron) 라고 한다.

즉, perceptron 1개를 하나의 Layer라고 생각하고 층을 여러개 쌓은 모델을 만들었다고 생각하면 된다.

1개만 사용했던 perceptron을 여러개 쌓았을 때, XOR GATE의 문제는 다음과 같이 해결된다.

물론, 다른 방식으로 그려질 수도 있다.

MLP 방식을 도식화하면, 다음과 같다.

Input Layer와 Output Layer만 있을 경우, 가장 기본적인 perceptron을 의미하며 Hidden Layer가 늘어날수록 더 복잡한 MLP 모델이 만들어진다.

'학부 > AI 관련 공부' 카테고리의 다른 글

| Natural Language Processing, Normalization 이란? (3) (0) | 2023.08.21 |

|---|---|

| 크롤링을 위한 HTML / CSS 간단 소개 (NLP) (0) | 2023.08.20 |

| Natural Language Processing, Cleaning 이란? (2) (0) | 2023.08.14 |

| Natural Language Processing, Tokenization이란? (1) (0) | 2023.08.14 |

| ML 스터디 간단하게 정리하기 (0) | 2023.05.11 |